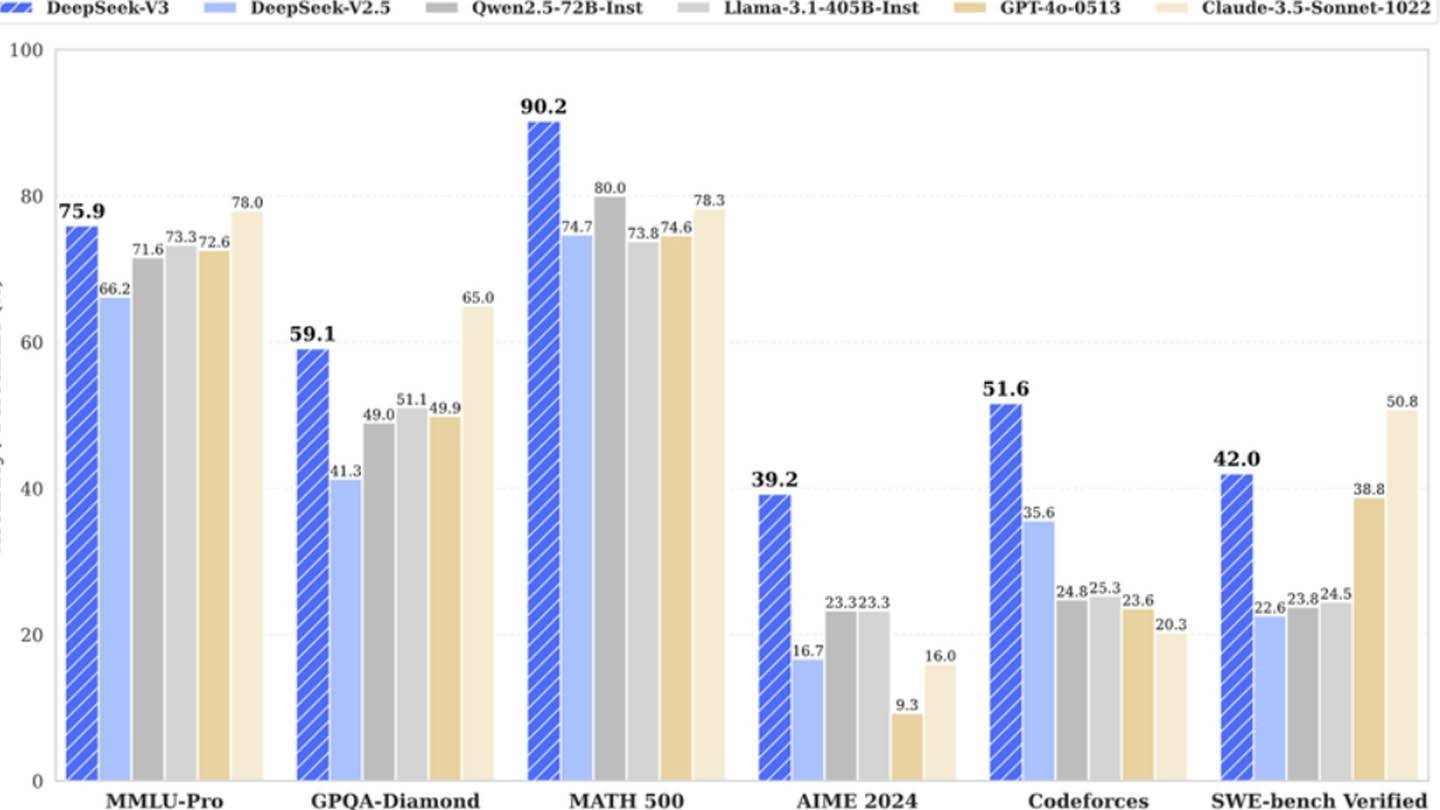

Deepseekの驚くほど安価なAIモデルは、業界の規範に挑戦しています。同社は、2048 GPUを使用して、強力なDeepseek V3ニューラルネットワークをわずか600万ドルで訓練したと主張しており、競合他社を大幅に下げています。ただし、この数字は、トレーニング前のGPUコストのみを反映しており、実質的な調査、改良、データ処理、インフラストラクチャ費用を省略しています。

画像:Ensigame.com

画像:Ensigame.com

Deepseek V3の革新的なアーキテクチャは、その効率の鍵です。それは利用します:

- マルチトークン予測(MTP):精度と速度を改善するために複数の単語を同時に予測します。

- 専門家(MOE)の混合物: 256のニューラルネットワークを採用し、トークンごとに8つをアクティブにし、トレーニングを加速し、パフォーマンスを向上させます。

- マルチヘッドの潜在的注意(MLA):情報の損失を最小限に抑え、重要なニュアンスをキャプチャするために、重要な詳細を繰り返し抽出します。

画像:Ensigame.com

画像:Ensigame.com

トレーニングコストの請求が少ないにもかかわらず、SemianalysisはDeepseekの実質的なインフラストラクチャを明らかにしました。約50,000のNvidia Hopper GPU(10,000 H800、10,000 H100、および追加のH20 GPUを含む)は、複数のデータセンターに広がっています。これは、サーバーの総投資額を約16億ドルで、運用コストは9億4,400万ドルと推定されています。これは、公表された600万ドルのトレーニング前のコストと大幅に対照的です。

画像:Ensigame.com

画像:Ensigame.com

中国のヘッジファンドであるHigh-Flyerの子会社であるDeepseekは、データセンターを所有しており、コントロールとより高速なイノベーションの実装を提供しています。その自己資金の性質は敏ility性を高めます。同社は中国のトップの才能を引き付け、一部の研究者は年間130万ドル以上を稼いでいます。 DeepSeekの費用対効果は相対的ですが、その成功は実質的な投資、技術の進歩、高度なスキルのあるチームに由来しています。

画像:Ensigame.com

画像:Ensigame.com

AI開発への全体的な投資は5億ドルを超えています。その合理化された構造は、より大きく、より官僚的な組織と比較して、効率的なイノベーションを促進します。 「革新的な予算」の物語は間違いなく膨らんでいますが、DeepSeekのモデルトレーニングコスト(R1の場合は500万ドル)は、ChatGPT4O(1億ドル)のような競合他社の依然として大幅に削減されています。最終的に、Deepseekは、十分に資金提供された独立したAI企業が確立された巨人と効果的に競争する可能性を示しています。